Proporcionar atención al cliente multilingüe efectiva en empresas globales presenta desafíos operativos significativos. A través de la colaboración entre la tecnología AWS y DXC, hemos desarrollado un prototipo de traducción escalable de voz a voz (V2V) que transforma cómo los centros de contacto manejan las interacciones multilingües de los clientes.

En esta publicación, discutimos cómo AWS y DXC usaron amazon Connect y otros servicios de AWS ai para ofrecer capacidades de traducción V2V casi en tiempo real.

Desafío: servir a los clientes en varios idiomas

En el tercer trimestre de 2024, la tecnología DXC se acercó a AWS con un desafío comercial crítico: sus centros de contacto globales necesitaban servir a los clientes en múltiples idiomas sin el costo exponencial de contratar agentes específicos del lenguaje para los idiomas de menor volumen. Anteriormente, DXC había explorado varias alternativas existentes, pero encontró limitaciones en cada enfoque, desde limitaciones de comunicación hasta requisitos de infraestructura que afectaron la confiabilidad, la escalabilidad y los costos operativos. DXC y AWS decidieron organizar un hackathon enfocado donde colaboraron los arquitectos de soluciones DXC y AWS:

- Definir requisitos esenciales para la traducción en tiempo real

- Establecer puntos de referencia de latencia y precisión

- Crear rutas de integración perfecta con los sistemas existentes

- Desarrollar una estrategia de implementación por etapas

- Prepare y pruebe una comprobante inicial de configuración de concepto

Impacto comercial

Para DXC, este prototipo se utilizó como un habilitador, lo que permite la maximización técnica del talento, la transformación operativa y las mejoras de costos a través de:

- Mejor entrega de experiencia técnica: agentes de contratación y correspondencia basados en el conocimiento técnico en lugar del lenguaje hablado, asegurándose de que los clientes obtengan el máximo soporte técnico, independientemente de las barreras del idioma

- Flexibilidad operativa global: eliminación de limitaciones geográficas y de lenguaje en la contratación, colocación y apoyo a la entrega mientras mantiene una calidad de servicio consistente en todos los idiomas

- Reducción de costos: eliminación de primas de experiencia en varios idiomas, capacitación de idiomas especializados y costos de infraestructura a través del modelo de traducción de pago por uso

- Experiencia similar a los hablantes nativos: manteniendo el flujo de conversación natural con traducción casi en tiempo real y comentarios de audio, al tiempo que ofrece soporte técnico premium en el lenguaje preferido del cliente.

Descripción general de la solución

El prototipo de traducción de amazon Connect V2V utiliza tecnologías avanzadas de reconocimiento de voz y traducción automática de AWS para permitir la traducción de conversación en tiempo real entre agentes y clientes, lo que les permite hablar en sus idiomas preferidos mientras tiene conversaciones naturales. Consiste en los siguientes componentes clave:

- Reconocimiento de voz: el lenguaje hablado del cliente se captura y se convierte en texto utilizando amazon Transcribe, que sirve como motor de reconocimiento de voz. La transcripción (texto) se alimenta al motor de traducción automática.

- Traducción automática: amazon Translate, el motor de traducción automática, traduce la transcripción del cliente al idioma preferido del agente en tiempo casi real. La transcripción traducida se convierte nuevamente en discurso usando amazon Polly, que sirve como motor de texto a voz.

- Traducción bidireccional: el proceso se invierte para la respuesta del agente, traduciendo su discurso al idioma del cliente y entregando el audio traducido al cliente.

- Integración perfecta: el proyecto de muestra de traducción V2V se integra con amazon Connect, lo que permite a los agentes manejar las interacciones de los clientes en varios idiomas sin ningún esfuerzo o capacitación adicional, utilizando el <a target="_blank" href="https://github.com/amazon-connect/amazon-connect-streams” target=”_blank” rel=”noopener”>amazon Connect Streams JS y amazon Connect RTC JS bibliotecas.

El prototipo se puede extender con otros servicios de AWS ai para personalizar aún más las capacidades de traducción. Es de código abierto y está listo para la personalización para satisfacer sus necesidades específicas.

El siguiente diagrama ilustra la arquitectura de la solución.

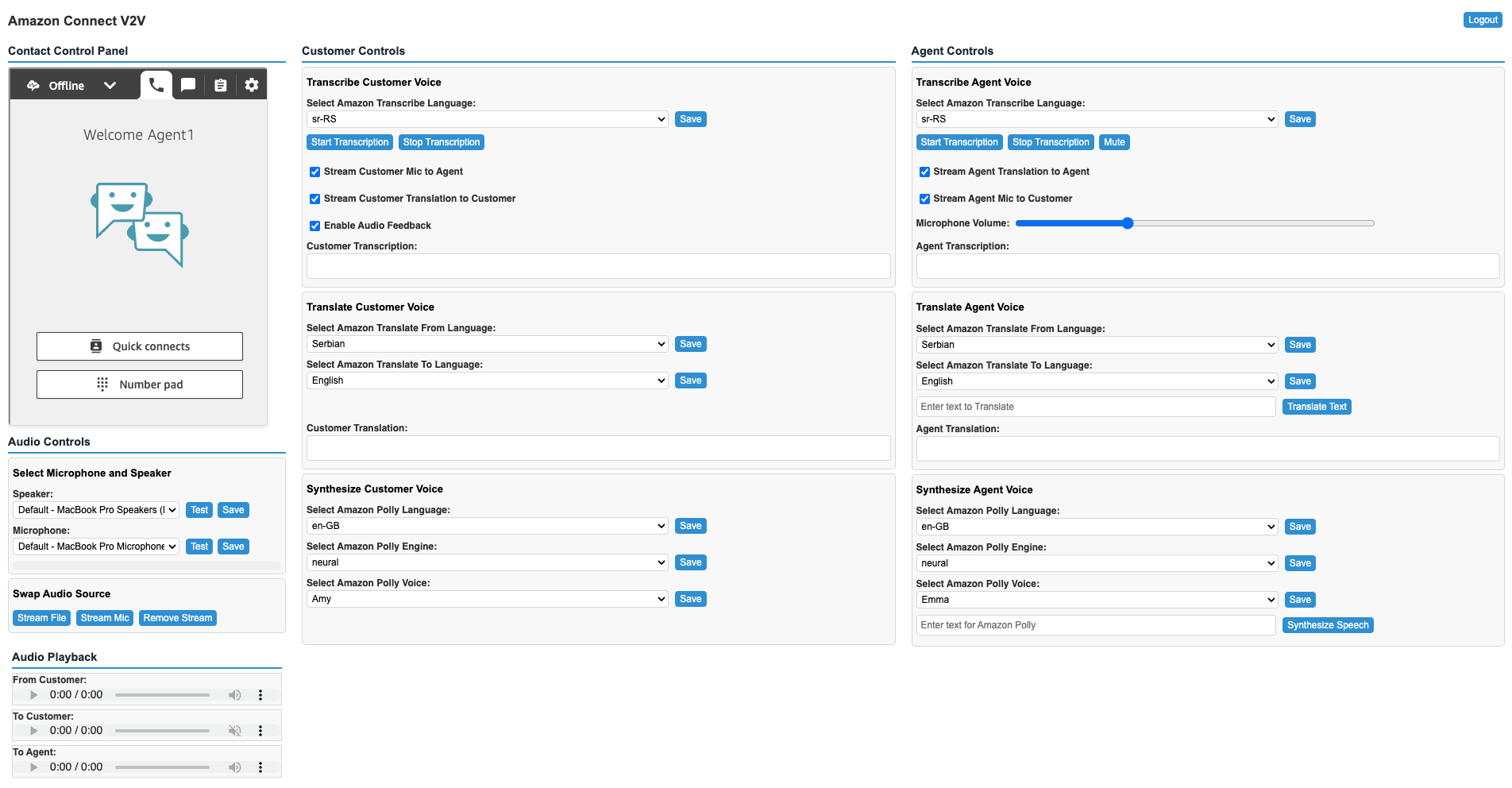

La siguiente captura de pantalla ilustra una aplicación web de agente de muestra.

La interfaz de usuario consta de tres secciones:

- Panel de control de contacto: un cliente de softphone que usa amazon Connect

- Controles de clientes: controles de interacción con el cliente a agente, incluida la voz de la transcripción del cliente, traducir la voz del cliente y sintetizar la voz del cliente

- Controles del agente: controles de interacción de agente a cliente, incluida la voz de agente de transcripción, la voz del agente traducido y la voz del agente de sintetización

Desafíos al implementar la traducción de voz casi en tiempo real

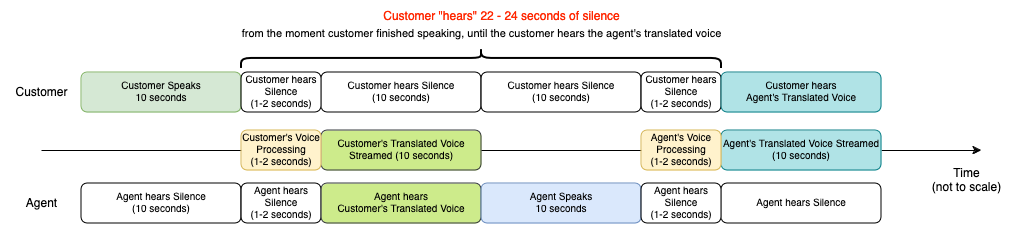

El proyecto de muestra de amazon Connect V2V fue diseñado para minimizar el tiempo de procesamiento de audio desde el momento en que el cliente o agente termina hablando hasta que se inicia la transmisión de audio traducida. Sin embargo, incluso con el tiempo de procesamiento de audio más corto, la experiencia del usuario todavía no coincide con la experiencia de una conversación real cuando ambos hablan el mismo idioma. Esto se debe al patrón específico de que el cliente solo escucha el discurso traducido del agente, y el agente solo escucha el discurso traducido del cliente. El siguiente diagrama muestra ese patrón.

El ejemplo de flujo de trabajo consta de los siguientes pasos:

- El cliente comienza a hablar en su propio idioma y habla durante 10 segundos.

- Debido a que el agente solo escucha el discurso traducido del cliente, el agente primero escucha 10 segundos de silencio.

- Cuando el cliente termina de hablar, el tiempo de procesamiento de audio lleva 1 a 2 segundos, durante el cual tanto el cliente como el agente escuchan el silencio.

- El discurso traducido del cliente se transmite al agente. Durante ese tiempo, el cliente escucha el silencio.

- Cuando se completa la reproducción del habla traducida del cliente, el agente comienza a hablar y habla durante 10 segundos.

- Debido a que el cliente solo escucha el discurso traducido del agente, el cliente escucha 10 segundos de silencio.

- Cuando el agente termina de hablar, el tiempo de procesamiento de audio toma 1 a 2 segundos, durante el cual tanto el cliente como el agente escuchan el silencio.

- El discurso traducido del agente se transmite al agente. Durante ese tiempo, el agente escucha el silencio.

En este escenario, el cliente escucha un solo bloque de 22–24 segundos de silencio completo, desde el momento en que terminaron de hablar hasta que escuchan la voz traducida del agente. Esto crea una experiencia subóptima, porque el cliente podría no estar seguro de lo que está sucediendo durante estos 22-24 segundos, por ejemplo, si el agente pudo escucharlos, o si hubo un problema técnico.

Complementos de transmisión de audio

En un escenario de conversación cara a cara entre dos personas que no hablan el mismo idioma, pueden tener otra persona como traductor o intérprete. Un ejemplo de flujo de trabajo consta de los siguientes pasos:

- La persona A habla en su propio idioma, que la persona B y el traductor escucha.

- El traductor traduce lo que una persona dijo al idioma de la persona B. La traducción es escuchada por la persona B y la persona A.

Esencialmente, la persona A y la persona B se escuchan hablar su propio idioma, y también escuchan la traducción (del traductor). No hay espera en silencio, que es aún más importante en las conversaciones no cara a cara (como las interacciones del centro de contacto).

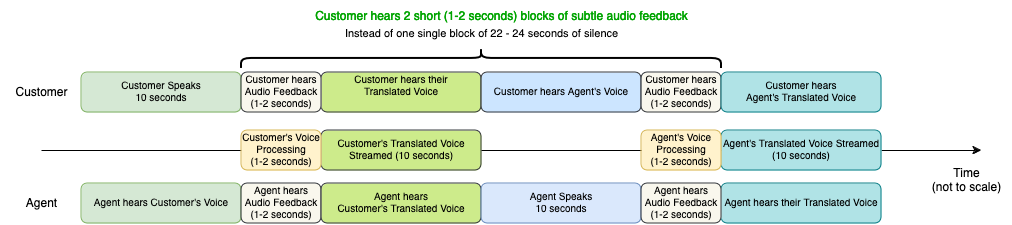

Para optimizar la experiencia del cliente/agente, el proyecto de muestra amazon Connect V2V implementa complementos de transmisión de audio para simular una experiencia de conversación más natural. El siguiente diagrama ilustra un flujo de trabajo de ejemplo.

El flujo de trabajo consta de los siguientes pasos:

- El cliente comienza a hablar en su propio idioma y habla durante 10 segundos.

- El agente escucha la voz original del cliente, a un volumen más bajo (“Transmitir el micrófono del cliente al agente” habilitado).

- Cuando el cliente termina de hablar, el tiempo de procesamiento de audio toma 1 a 2 segundos. Durante ese tiempo, el cliente y el agente escuchan comentarios sutiles de audio, contactar ruido de fondo del centro, a un volumen muy bajo (“Comentarios de audio” habilitado).

- El discurso traducido del cliente se transmite al agente. Durante ese tiempo, el Cliente escucha su discurso traducido, a un volumen más bajo (“Traducción del cliente de transmisión al cliente” habilitado).

- Cuando se completa la reproducción del habla traducida del cliente, el agente comienza a hablar y habla durante 10 segundos.

- El cliente escucha la voz original del agente, a un volumen más bajo (habilitado el “micrófono de agente de flujo al cliente”).

- Cuando el agente termina de hablar, el tiempo de procesamiento de audio lleva 1 a 2 segundos. Durante ese tiempo, el cliente y el agente escuchan comentarios sutiles de audio, contactar ruido de fondo del centro, a un volumen muy bajo (“Comentarios de audio” habilitado).

- El discurso traducido del agente se transmite al agente. Durante ese tiempo, el agente escucha su discurso traducido, a un volumen más bajo (“Traducción del agente de flujo al agente” habilitado).

En este escenario, el cliente escucha dos bloques cortos (1–2 segundos) de sutiles comentarios de audio, en lugar de un solo bloque de 22–24 segundos de silencio completo. Este patrón está mucho más cerca de una conversación cara a cara que incluye un traductor.

Los complementos de transmisión de audio proporcionan beneficios adicionales, que incluyen:

- Características de voz: en los casos en que el agente y el cliente solo escuchan su discurso traducido y sintetizado, se pierden las características de voz reales. Por ejemplo, el agente no puede escuchar si el cliente hablaba lento o rápido, si el cliente estaba molesto o tranquilo, y así sucesivamente. El discurso traducido y sintetizado no lleva esa información.

- Garantía de calidad: en los casos en que la grabación de llamadas está habilitada, solo se registran la voz original del cliente y el discurso sintetizado del agente, porque la traducción y la sintetización se realizan en el lado del agente (cliente). Esto dificulta que los equipos de control de calidad evalúen y auditen adecuadamente las conversaciones, incluidos los muchos bloques silenciosos dentro de él. En cambio, cuando los complementos de transmisión de audio están habilitados, no hay bloques silenciosos, y el equipo de control de calidad puede escuchar la voz original del agente, la voz original del cliente y su respectivo discurso traducido y sintetizado, todo en un solo archivo de audio.

- Precisión de transcripción y traducción: tener el discurso original y traducido disponible en la grabación de llamadas hace que sea sencillo detectar palabras específicas que mejoren la precisión de la transcripción (mediante el uso de vocabularios personalizados de amazon) o la precisión de la traducción (usando las terminologías personalizadas de amazon traducir), para hacer que Seguro que sus marcas, nombres de personajes, nombres de modelos y otro contenido único se transcriben y traducen al resultado deseado.

Comience con amazon Connect V2V

¿Listo para transformar la comunicación de su centro de contacto? Nuestro proyecto de muestra de amazon Connect V2V ahora está disponible en Girub. Te invitamos a explorar, desplegar y experimentar con este poderoso prototipo. Puede ser una base para desarrollar soluciones innovadoras de comunicación multilingüe en su propio centro de contacto, a través de los siguientes pasos clave:

- Clon el repositorio de GitHub.

- Pruebe diferentes configuraciones para complementos de transmisión de audio.

- Revise las limitaciones del proyecto de muestra en el ReadMe.

- Desarrolle su estrategia de implementación:

- Implemente controles sólidos de seguridad y cumplimiento que cumplan con los estándares de su organización.

- Colabore con su equipo de experiencia del cliente para definir los requisitos de su caso de uso específicos.

- Balance de la automatización y los controles manuales del agente (por ejemplo, use un flujo de contacto de amazon Connect para configurar automáticamente los atributos de contacto para idiomas preferidos y complementos de transmisión de audio).

- Use sus motores preferidos de transcripción, traducción y texto a voz, basados en requisitos específicos de soporte del idioma y preferencias comerciales, legales y regionales.

- Planifique un despliegue por etapa, comenzando con un grupo piloto, luego optimice de forma iterativa su transcripción vocabularios personalizados y terminologías personalizadas de traducción.

Conclusión

El proyecto de muestra de amazon Connect V2V demuestra cómo amazon Connect y los servicios avanzados de AWS ai pueden desglosar las barreras del idioma, mejorar la flexibilidad operativa y reducir los costos de soporte. ¡Comience ahora y revolucione cómo se comunica su centro de contacto a través de las barreras del idioma!

Sobre los autores

Milos Cosic es un arquitecto principal de soluciones en AWS.

Milos Cosic es un arquitecto principal de soluciones en AWS.

miJFErrell es un arquitecto de soluciones senior en AWS.

miJFErrell es un arquitecto de soluciones senior en AWS.

Adam El Tanbouli es un gerente de programa técnico para prototipos y servicios de soporte en DXC Modern Workplace.

Adam El Tanbouli es un gerente de programa técnico para prototipos y servicios de soporte en DXC Modern Workplace.

NEWSLETTER

NEWSLETTER